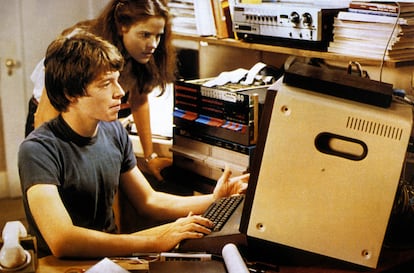

En 1983, la película Juegos de Guerra se convirtió en un éxito de taquilla. Protagonizada por un jovencísimo Matthew Broderick, contaba la historia de un pirata informático adolescente que se enfrenta a un superordenador controlado por una inteligencia artificial llamada Joshua. La máquina, que gestionaba el arsenal de misiles nucleares de Estados Unidos, estaba fuera de control y amenazaba con desatar una guerra atómica. Con el tiempo la cinta se convirtió en una obra de culto por anticipar varias generaciones los riesgos de conceder a una máquina el poder de la guerra sin supervisión humana.

Cuatro décadas después del estreno de aquella icónica película, Estados Unidos parece revivir algunos de los dilemas morales que planteaba el metraje dirigido por John Badham. El límite del uso de la inteligencia artificial para fines bélicos alimenta un debate planetario con consecuencias reales.

El presidente de Estados Unidos, Donald Trump, ha ordenado cancelar todos los contratos con Anthropic, una de las compañías punteras en inteligencia artificial (IA), en una polémica decisión con implicaciones políticas, empresariales y tecnológicas. La Casa Blanca justifica que aparta a Anthropic por la negativa de su fundador, Dario Amodei, a liberar todas las funcionalidades de su herramienta de IA, bautizada como Claude. Amodei ha trazado dos líneas rojas esenciales para las que no está dispuesto a permitir el uso de su tecnología: no debe servir para el espionaje masivo de ciudadanos, ni para la gestión de armas autónomas sin manejo humano. Esta vez, en un hecho insólito, es la empresa la que marca los límites al Gobierno.

“Los acontecimientos de los últimos días han marcado un momento decisivo para la independencia de las empresas privadas de IA respecto al gobierno estadounidense y han dejado claro que, sin legislación, el uso de estas herramientas para la guerra y la vigilancia no es cuestión de si serán, sino de cuándo”, señala Adam Cooner, analista del Center for American Progress. “También ha sido otro ejemplo del intento de la Administración Trump de abusar de su poder y tomar medidas probablemente ilegales para intentar destruir un laboratorio de IA fronterizo que no estaba de acuerdo con el gobierno”, agrega.

La ruptura de los contratos del ejército estadounidense con Anthropic es un asunto delicado. Hasta el momento, Claude es la única IA utilizada por el Pentágono para la gestión de archivos clasificados en la nube. Los mandos militares usaron Claude durante las operaciones para capturar al expresidente venezolano, Nicolás Maduro, y su esposa en Caracas. También lo están empleando en el ataque de Estados Unidos a Irán para derribar el régimen teocrático.

Claude, el alter ego de Joshua de la película Juegos de Guerra, es esencial en el sistema inteligente Maven. Un sofisticado programa, creado por Palantir y Anthropic, que recaba datos de numerosas fuentes digitales para analizar y asistir al ejército en la toma de decisiones. Es la tecnología más avanzada que jamás se haya usado en operaciones militares. Está permitiendo al ejército obtener valiosa información a partir de una cantidad ingente de datos clasificados de satélites, vigilancia y otras fuentes digitales, que sirve para la planificación de operaciones e identificación de objetivos en tiempo real en la guerra de Irán.

Una decisión delicada

El uso de Claude en esta operación es tan relevante que plantea al Pentágono la dificultad de renunciar a esta herramienta de IA, cuando transcurran los seis meses de moratoria concedida por Trump. Pero varios funcionarios gubernamentales reconocen que Claude es mejor que sus competidores, como ChatGPT (OpenAI); Gemini (Google) y Grok (xAI) y admiten que eliminar las herramientas de Anthropic de sus operaciones será una tarea complicada.

El caso de Anthropic plantea un dilema que afecta no solo a la guerra, si no al desarrollo mismo de la tecnología: dónde están los límites de la IA, con cuestiones éticas y morales pendientes de resolver y, probablemente, de legislar. Pero en la industria de la IA las cosas van tan rápidas que las preguntas se quedan sin responder antes de que un nuevo avance tecnológico plantee nuevas cuestiones. Amodei, convertido en un gurú, asegura que la mejora de la IA es exponencial por semanas, a una velocidad sin precedentes, lo que alimenta el riesgo sobre su uso.

Las relaciones entre la Casa Blanca y Anthropic no siempre fueron tensas. Hace un año, la compañía de Dario Amodei firmó un contrato de 200 millones de dólares (172 millones de euros) con el Pentágono para la gestión de archivos clasificados en un entorno seguro en la nube. Claude es la IA más desarrollada para entornos corporativos con estándares de seguridad mayores que sus rivales. Pero el pasado 9 de enero, el secretario de Defensa, Pete Hegseth, presentó la nueva estrategia de seguridad que incluía un apartado especial para impulsar la IA en actividades militares. Entonces empezaron las preguntas.

Los recelos se convirtieron en desconfianza cuando el Pentágono se enteró de una conversación entre un empleado de Anthropic y otro de Palantir. El primero preguntaba si Claude se había utilizado en la operación para capturar a Maduro.

El Pentágono considera que los contratistas de defensa no deben poner límites al uso de los servicios. Utiliza el símil de las bombas: un fabricante de munición no pregunta contra quién se va a disparar un determinado proyectil ni en qué condiciones se suministra y corresponde al ejército determinar su uso. Y lanzan la pregunta: “¿Qué debería hacer un gobierno si una empresa privada logra un arma nuclear con la IA? Eso es lo que estamos viendo”.

Hegseth, que ha rebautizado a su ministerio como Departamento de Guerra (DoW, en sus siglas en inglés), citó a Amodei en el Pentágono para convencerle que el uso de Claude no podía tener limitaciones y se podría emplear “en cualquier uso legal”. Es la fórmula jurídica empleada para asegurarle que no lo utilizarían para el espionaje masivo ni para armamento autónomo sin supervisión. Pero la solución no satisfizo a Amodei. Durante la reunión, Hegseth le dio un ultimátum: si antes de tres días no aceptaba las condiciones invocaría la Ley de Producción de Defensa, de 1950, que se empleó durante la guerra de Corea, para obligar a la empresa a colaborar con el Gobierno sin restricciones. También amenazó con calificar a Anthropic como “un riesgo para la cadena de suministro”, una medida extraordinaria que prohibiría a la empresa hacer negocios con otros contratistas militares.

Hay que recordar que Hegseth, una ex estrella televisiva de la FoxNews, reunió a los altos mandos militares a finales del pasado septiembre para explicarles su idea de cómo deben ser las Fuerzas Armadas estadounidenses: un ejército compuesto por “guerreros” y no “defensores”. Entonces, dejó una frase como declaración de principios de su mandato: “El ejército estadounidense no está para proteger los sentimientos de nadie, sino para proteger nuestro país, y no seremos políticamente correctos a la hora de defender la libertad estadounidense”.

Posibles errores

La escalada verbal entre ambos subió de tono. Amodei asegura que las amenazas de la Administración Trump son contradictorias. Por un lado sostienen que Claude era esencial, y por el otro que es prescindible. Además, precisa que no se opone categóricamente a que las armas sean totalmente autónomas, un paso que podría vulnerar las leyes internacionales, si no que su tecnología no está lo suficientemente madura para evitar errores. Respecto a la vigilancia señala que aunque el Pentágono asegura que cumplirá con la ley, el problema es que la legislación no está adaptada al uso de la IA.

El Gobierno, dice Amodei, ya puede recopilar información, realizar escaneo masivo, recabar datos biométricos, huellas, información fiscal, intervenir comunicaciones telefónicas y geolocalizar, entre otras. La IA puede recopilar estos datos dispersos individualmente inofensivos para obtener una imagen completa de la vida de cualquier persona, de forma automática y a gran escala.

Amodei pone el siguiente ejemplo: “Un enjambre de millones o miles de millones de drones armados totalmente automatizados, controlados localmente por una IA potente y coordinados estratégicamente en todo el mundo por una IA aún más poderosa, podría constituir un ejército imbatible, capaz tanto de derrotar a cualquier ejército del mundo como de reprimir la disidencia dentro de un país siguiendo a cada ciudadano”. Habría un riesgo mucho mayor de que los países democráticos volvieran ejércitos de IA contra su propia población, remarca Amodei, a quien la preocupa que el Gobierno pueda comprar datos masivos de ciudadanos para hacer perfiles con la IA sobre filiación política, descontento, opositores, etcétera.

El Pentágono, por su parte, plantea la hipótesis de un ataque sorpresa. “¿Qué pasaría si un misil balístico intercontinental con armas nucleares se dirigiera hacia Estados Unidos con solo 90 segundos de anticipación y la IA de Anthropic fuera la única forma de desencadenar una respuesta de misiles para salvar al país, pero las medidas de seguridad de la compañía no lo permitieran?”, reflexionó un alto funcionario en una llamada telefónica a Anthropic en diciembre. Las versiones de la respuesta son contradictorias. El Departamento de Guerra asegura que Amodei respondió “llámame”, una posibilidad que les daba vértigo porque sería dejar en manos de un empresario la respuesta militar a una agresión. Anthropic defiende que el Pentágono podría usar sus herramientas de IA para la defensa antimisiles y las operaciones cibernéticas sin límites en esos casos.

Antes de que venciera el plazo marcado por Hegseth, Trump cortó por lo sano. “¡Los Estados Unidos de América jamás permitirán que una empresa radical de izquierda y ‘woke’ decida cómo nuestro ejército lucha y gana guerras! Esa decisión le corresponde a su comandante en jefe y a los extraordinarios líderes que designo para dirigir nuestras Fuerzas Armadas”, escribió en su red social, Truth.

De esta forma, la Administración Trump cortaba todos los contratos con Anthropic, pero dejaba seis meses de plazo para poder desengancharse sin provocar grandes daños. Ese mismo día por la noche, OpenAI, el rival de Anthropic anunció un contrato con el Pentágono por 200 millones para gestionar archivos clasificados como hacía la empresa de Amodei.

“Ningún contratista, proveedor o socio que haga negocios con el ejército de Estados Unidos podrá realizar ninguna actividad comercial con Anthropic”, escribió Hegseth en X para cumplir su amenaza. Anthropic anunció que demandaría a la Casa Blanca por romper el contrato y catalogarla como un riesgo para la cadena de suministro. El contrato con el Pentágono no supone mucho para una compañía valorada en más de 350.000 millones de dólares y una facturación anual que roza los 20.000 millones, pero Anthopic tiene una vasta cartera de clientes como Amazon, Boeing, Lockhead Martin, Palantir, etcétera, con estrechos lazos con la Administración estadounidense. Si Trump cumple su palabra, sería mortal para Claude. Amodei sostiene que la prohibición para contratar con otras empresas solo sería aplicable para usos militares, lo que aliviaría el golpe económico. Pero eso está por ver. La cadena CNBC publicó esta semana que varias empresas de tecnología de defensa están pidiendo a sus empleados que dejen de usar Claude de Anthropic y que cambien a otros modelos de IA.

La inclusión de Anthropic en la lista negra del Gobierno es algo completamente inusual para una empresa estadounidense, y se había empleado para casos como el de Huawei o ZTE, con supuestos lazos con China o la empresa de ciberseguridad Kaspersky, ligada a Moscú. Por eso y por las consecuencias de romper con Anthropic, el Consejo de la Industria de Tecnología de la Información (ITI), un organización de compañías tecnológicas, donde participan Nvidia, AMD, Google o Apple envió una carta a Hegseth expresando su preocupación por la designación de una empresa estadounidense como un riesgo para la cadena de suministro.

“Aunque solo afecte directamente a Anthropic, poner la empresa en listas negras también señalaría a numerosas otras compañías lo que el gobierno está dispuesto a hacer para forzar ciertas acciones en sus productos, enviando un efecto dominó en este momento crítico del desarrollo tecnológico. El resultado podría perjudicar no solo los desarrollos aquí en Estados Unidos, sino también el éxito global de líderes en IA como Anthropic”, explica de Jennifer Huddleston, investigadora principal en política tecnológica en el Instituto Cato.

Orígenes diferentes

Para entender el conflicto hay que conocer el origen de ambas empresas. Anthropic se fundó en 2021 por siete investigadores que abandonaron OpenAI por principio éticos alarmados por los problemas de seguridad de ChatGPT. Han hecho bandera del compromiso moral en el desarrollo de la IA, a la que han dotado de una “constitución”, la ponen a prueba para evitar errores éticos y, aunque recientemente han aligerado las barreras de seguridad para acelerar el desarrollo del negocio, insisten en que la IA debe ser segura para la sociedad.

También hay una vertiente política. Amodei apoyó a Joe Biden y Kamala Harris en las pasadas elecciones presidenciales. Ha cuestionado a Trump en varias ocasiones al defender una mayor regulación de la IA. Lo criticó cuando el mandatario estadounidense permitió la venta de chips de Nvidia a China. “Es como vender armas nucleares a Corea del Norte”, dijo hace unas semanas en Davos. Además, ha contratado a varios altos cargos de la Administración Biden. Por su parte, Sam Altman, el líder de OpenAI, es amigo de Elon Musk, el fundador de Tesla, y coquetea con el entorno de Trump.

“La gobernanza del sector privado no es suficiente para frenar el uso gubernamental y el posible abuso de la IA avanzada. El Congreso no puede esperar para actuar y debe comenzar a celebrar audiencias para investigar las acciones de la administración y elaborar legislación que proteja a los ciudadanos contra la vigilancia masiva”, apunta Conner (CAP).

Mientras las bombas siguen cayendo sobre Teherán con ayuda de Claude, Amodei continúa negociando con el Pentágono para recuperar el contrato roto por Trump, según adelantó esta semana Financial Times. Pero no será fácil por el grueso intercambio verbal entre ambos contendientes. Emil Michael, el director de tecnología del Departamento de Defensa, acusó de “mentiroso” a Amodei, de quien dijo: “Quiere jugar a ser Dios”.

“Se ha causado un gran daño a la industria. Incluso en la designación de riesgo de cadena de suministro más estrecha, el gobierno estadounidense sigue diciendo que te tratará como a un adversario extranjero por negarte a ceder a sus condiciones de negocio. Simplemente por tener ideas diferentes, expresarlas en el discurso y materializar ese discurso en las decisiones sobre cómo desplegar o no desplegar la propia propiedad. Cada uno de estos es fundamental para nuestra república, y cada uno fue asaltado por el Departamento de Guerra la semana pasada. La mayoría de las corporaciones, actores políticos y otros tendrán que operar bajo la suposición de que la lógica de la tribu reinará ahora”, señala Dean W. Ball, que fue asesor principal de políticas en la Oficina de Política Científica y Tecnológica de la Casa Blanca.